SK하이닉스, ‘소캠2’ 양산 돌입…엔비디아 차세대 AI 시대 선점

- 베라 루빈 맞춤형 메모리…속도 2배·전력 효율 75% 개선

- AI 병목 해소 핵심 솔루션…추론 중심 시장 전환 대응

SK하이닉스가 차세대 인공지능(AI) 서버 시장 공략을 본격화한다. 기존 메모리 구조의 한계를 뛰어넘는 신형 모듈 양산에 돌입하며 글로벌 AI 인프라 경쟁에서 주도권 확보에 나선 것이다.

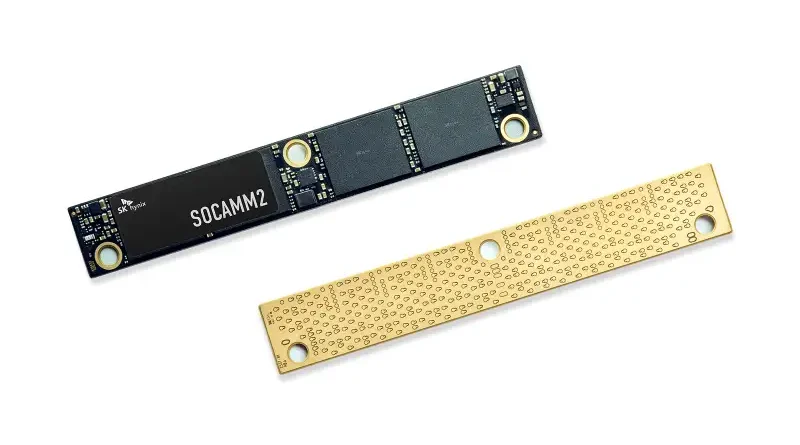

SK하이닉스는 10나노급 6세대(1c) LPDDR5X 기반 ‘소캠(SOCAMM)2 192GB’ 제품을 본격 양산한다고 밝혔다. 이 제품은 엔비디아의 차세대 AI 플랫폼 ‘베라 루빈’에 최적화된 서버용 메모리로, 초거대 AI 모델 처리에 특화된 구조를 갖춘 것이 특징이다.

소캠2는 기존 서버용 메모리인 RDIMM 대비 성능을 획기적으로 끌어올렸다. 데이터 처리 대역폭은 2배 이상 확대됐고, 에너지 효율은 75% 이상 개선됐다. 특히 모바일 기기에 주로 쓰이던 저전력 메모리(LPDDR)를 서버 환경에 맞게 재설계해 전력 소모를 줄이면서도 고성능을 유지할 수 있도록 했다.

이 제품의 핵심 경쟁력은 AI 연산의 ‘메모리 병목 현상’을 해결하는 데 있다. AI 모델은 수천억 개의 파라미터를 동시에 처리해야 하는데, 기존에는 GPU 성능 대비 메모리 데이터 공급이 따라가지 못해 전체 시스템 효율이 떨어지는 문제가 있었다. 소캠2는 이러한 구조적 한계를 개선해 데이터 처리 속도를 비약적으로 높이고, AI 학습과 추론 전반의 효율을 끌어올릴 수 있다.

또한 얇은 두께와 압착식 커넥터 구조를 적용해 서버 공간 활용도를 높이고, 모듈 교체 및 확장성을 강화한 점도 특징이다. 이는 대규모 데이터센터 운영 효율을 높이는 요소로 작용할 전망이다.

이번 양산은 AI 시장의 패러다임 변화와도 맞물린다. 최근 AI 산업은 대규모 학습 중심에서 실제 서비스에 적용되는 ‘추론’ 중심으로 빠르게 이동하고 있다. 이에 따라 전력 효율과 실시간 처리 성능을 동시에 확보할 수 있는 메모리 솔루션의 중요성이 커지고 있다. 소캠2는 이러한 흐름에 대응해 거대언어모델(LLM)을 저전력으로 상시 구동할 수 있는 환경을 제공한다.

SK하이닉스는 글로벌 클라우드 서비스 제공자(CSP)의 수요 증가에 대응해 양산 체제를 조기 안정화했으며, 이를 기반으로 AI 서버 메모리 시장 점유율 확대를 노리고 있다. 시장조사업체들은 소캠2를 포함한 차세대 서버용 메모리 시장이 연평균 60% 이상의 고성장을 이어가며 2027년 약 20억 달러 규모에 이를 것으로 전망하고 있다.

업계에서는 이번 제품을 SK하이닉스의 ‘포스트 HBM 전략’의 핵심으로 평가한다. 기존 고대역폭메모리(HBM)에 더해 다양한 AI 맞춤형 메모리 포트폴리오를 구축함으로써, 엔비디아 중심의 AI 생태계에서 영향력을 더욱 확대할 수 있기 때문이다.

결국 이번 소캠2 양산은 단순한 신제품 출시를 넘어 AI 인프라 경쟁의 핵심 축이 메모리로 이동하고 있음을 보여준다. 연산 성능을 넘어 데이터 흐름을 얼마나 효율적으로 처리하느냐가 AI 시대의 승부를 가르는 기준이 되고 있다.

더 좋은 미래를 위한 콘텐츠 플랫폼 – <굿퓨처데일리>